AI漫剧工具开源制作指南:从零打造个性化动漫视频生成器

在数字内容创作蓬勃发展的今天,AI漫剧工具正成为创作者将文字剧本自动转化为生动动漫视频的得力助手。对于技术爱好者和开发者而言,了解如何利用开源资源制作属于自己的AI漫剧工具,不仅充满挑战,更能打开个性化创作的大门。本文将为您解析其核心制作逻辑与关键步骤。

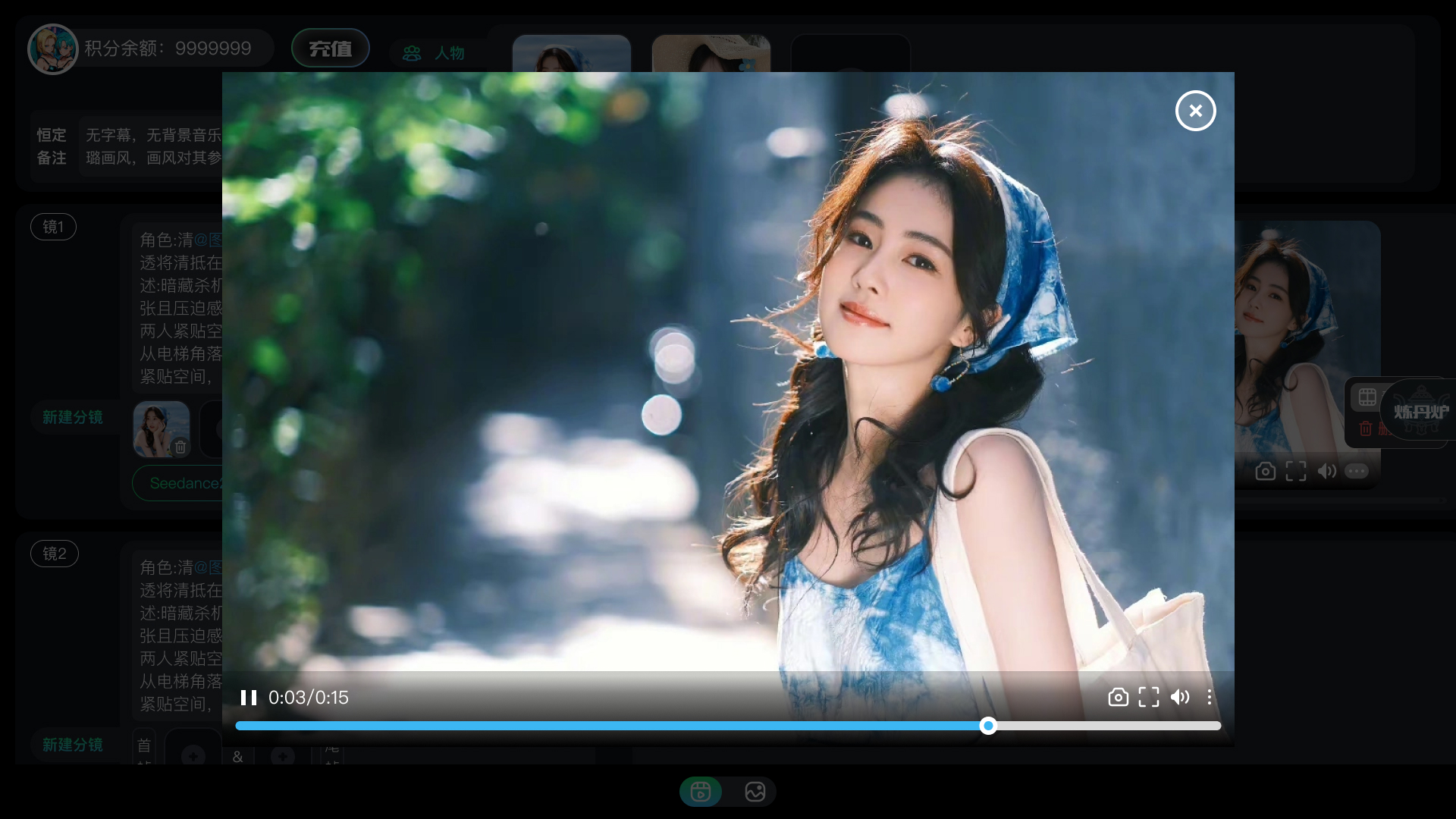

制作AI漫剧工具,本质上是一个融合自然语言处理、计算机视觉与图形渲染的跨领域工程。其核心流程通常分为三步:首先,工具需要理解用户输入的文字剧本或故事描述,这依赖于开源的自然语言处理模型,例如Hugging Face平台提供的各类预训练模型,它们能进行实体识别、情感分析和场景理解。其次,根据解析出的场景、角色和动作,工具需生成或调用相应的视觉元素。这里,开源的文本生成图像模型如Stable Diffusion成为关键,它可以根据描述生成一致的动漫风格角色与背景。最后,将这些静态画面串联成流畅视频,并添加语音和字幕,完成漫剧制作。其中,开源视频合成库与语音合成工具提供了技术支持。

对于开发者而言,启动这样一个开源项目,可以从GitHub等平台寻找相关基础模块。例如,结合使用LangChain进行剧本结构化管理,利用Stable Diffusion的WebUI或ComfyUI进行图像生成控制,再通过FFmpeg进行视频序列合成。整个系统的搭建强调模块化,允许开发者根据需求替换或优化每个环节。值得注意的是,制作过程中需重点关注角色一致性保持、动作自然度以及多镜头切换逻辑等难点,这可能需要训练专门的LoRA模型或设计控制网络。

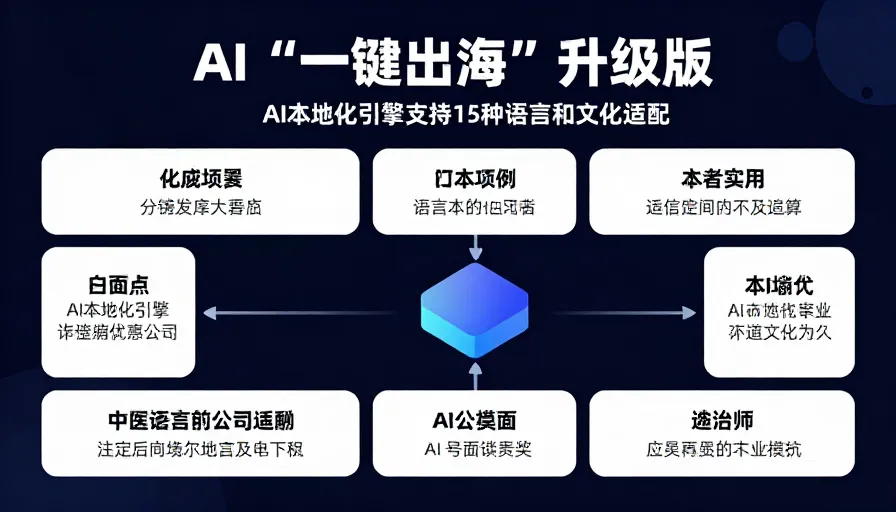

开源生态为AI漫剧工具制作提供了肥沃的土壤。通过集成和微调这些先进的开源模型,开发者能够以相对较低的成本构建出功能强大的原型。这不仅降低了AI视频创作的门槛,也为动漫内容生产的自动化与个性化带来了无限可能。随着技术的不断迭代,未来每个人都有可能成为自己动漫故事的导演。